itmo_conspects

Лекция 5. Задача детектирования объектов

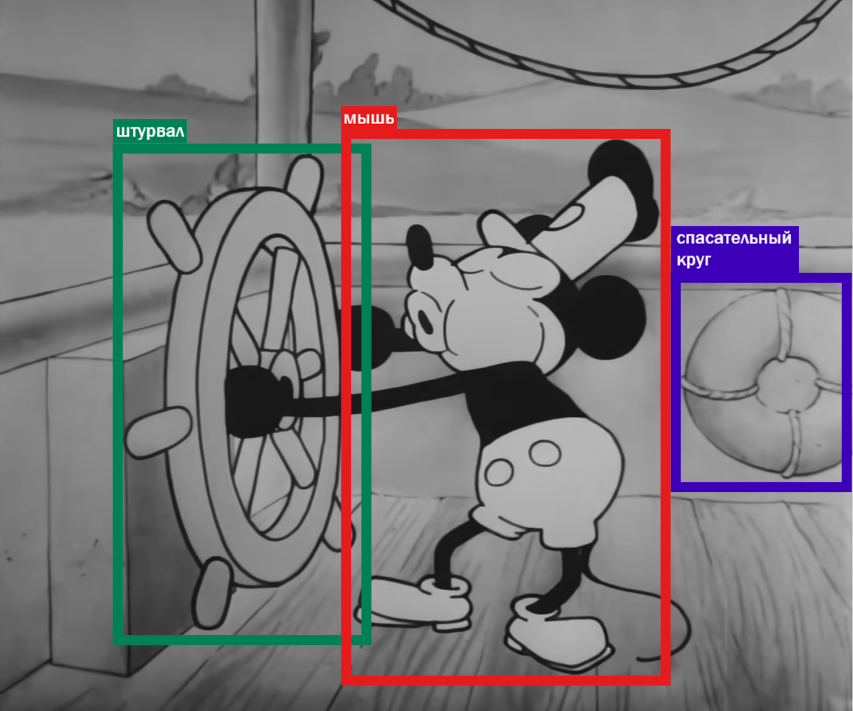

Задача детектирования объекта - обнаружение местоположения (ограничивающего прямоугольника, bounding box) и класса объекта на изображении

Допустим, модель нашла прямоугольник, в котором находится объект. Чтобы понять, насколько прямоугольник $D$ хорош, по сравнению с тем прямоугольником $T$, который мы задали в качестве истинного, используют метрики:

- Точность (Precision): $\mathrm{Precision} = \frac{\vert T \cap D \vert}{\vert D \vert}$

- Запоминание (Recall): $\mathrm{Recall} = \frac{\vert T \cap D \vert}{\vert T \vert}$

- Доля пересечения от объединения (Intersection over Union, IoU, или индекс Жаккара): $\mathrm{IoU} = \frac{\vert T \cap D \vert}{\vert T \cup D \vert}$

Для оценки качества на уровне классификации используют:

- Средную точность (Average Precision) - площадь под кривой Точность-Запоминание

- mAP (Mean Average Precision) - среднее взвешенное значение средней точности по всем классам

Всего модели по принципу работы можно разделить:

- На одностадийные: YOLO, SSD, RetinaNet

- На двухстадийные: R-CNN, Fast R-CNN, Mask R-CNN

- На основе точек: CenterNet, CornerNet

Одностадийная детекция

Самая популярная модуль одностадийной детекции - YOLO (от You Only Look Once). Работает она так:

-

Позвоночник этой модели в виде сверточной нейросети (например, ResNet, VGG или MobileNet) выделяет признаки изображения и выдает большой тензор признаков

-

Далее голова модели по признакам изображения предсказываются ограничивающие прямоугольники, уверенность в них в виде вероятности и метки классов

-

Постобработка предсказаний

После предсказания возникает проблема: два объекта могут попасть в одну ячейку. Поэтому можно добавить якоря - характерные размеры или пропорции объектов, задающиеся заранее

Такие нейронные сети для детекции генерируют очень много ограничивающих прямоугольников, поэтому нужно отсечь лишние, например:

- Отсечь те, у которых уверенность ниже какого-либо порога

- Использовать алгоритм Non-maximum suppression (NMS), оставляющий только наиболее уверенные боксы среди сильно перекрывающихся

Первая версия YOLO появилась в 2016 и получила развитие в виде семи последующих версий

Другая более ранняя модель SSD (Single-Shot Multibox Detector) предсказывала объекты с карт признаков разных масштабов

В SSD крупные объекты предсказываются из поздних карт признаков. Мелкие же объекты предсказываются из ранних карт, но в них нет информации о контексте, что является недостатком модели

В задаче детекции возникает проблема, что при детектировании количество фонового класса (отрицательных примеров) сильно превосходит количество объектов (положительных примеров). Стандартная функция потерь уделяет слишком много внимания лёгким примерам, поэтому используют функцию фокальных потерь (Focal Loss):

\[\mathrm{FL}(p_t) = -(1 - p_t)^\gamma \cdot \log(p_t),\]где $p_t$ - вероятность правильного класса, $\gamma > 0$ - параметр фокусировки

Модулирующий множитель $(1 - p_t)^\gamma$ уменьшает вклад хорошо классифицированных (лёгких) объектов, заставляя модель фокусироваться на сложных примерах

Двухстадийная детекция

Двухстадийный подход разделяет задачу на два этапа:

- Генерация кандидатов - нахождение областей, где вероятно есть объект. Такую роль может играть модель Region Proposal Network (RPN), основанная на классических методах компьютерного зрения

- Классификация и уточнение боксов - анализ каждого кандидата. Такие действия выполняет модель RoI Pooling (Region of Interest Polling), которая приводит области разного размера к единому размеру для последующей классификации

Для каждого кандидата предсказываются: координаты центра $(b_x, b_y)$, ширина и высота $(b_w, b_h)$, метка класса и уверенность

Самые популярных модели двухстадийной детекции - семейство R-CNN:

- R-CNN - кандидаты генерируются классическими методами компьютерного зрения

- Fast R-CNN - кандидаты генерируются нейронной сетью RPN

- Faster R-CNN - признаки RPN и RoI Pooling используют общий позвоночник

- Mask R-CNN - дополнительное предсказание маски сегментации объекта

Детектирование на основе точек

Есть две популярных модели, работающих на основе точек:

-

CenterNet - вместо ограничивающих прямоугольников напрямую предсказываются ключевые точки:

- Центр объекта

- Ширина и высота бокса

- Уверенность в наличии объекта в каждой точке

Дополнительно можно предсказывать глубину объекта, позу человека, положение суставов и так далее

-

EfficientDet - модель, где позвоночник - EfficientNet, а шея - это BiFPN (Bidirectional Feature Pyramid Network), двунаправленная сеть пирамиды признаков для лучшего объединения признаков разных масштабов

На практике детектируются множество объектов в реальной среде:

- Автотранспорт для реализации автопилота

- Люди для подсчета, расстояния между людьми, контроля на заводах

- Лица

- Текст на картинке

Распознавание текста

Задача распознавания текста (или оптическое распознавание символов) - задача нахождения расположения текста на изображении и предсказывания содержимое текста

Проблема реализации состоит в том, что текст на изображении может быть расположен в тени, наклонен или деформирован (например, на помятой бумаге), зашумлен или частично перекрыт

Чтобы убрать это, применяют:

- Выравнивание

- Подавление шума

- Бинаризация

- Удаление лишних линий

Существуют:

- Классические методы, например, предобработка, локализация символов, сегментация и распознавание символов

-

Глубокое обучение, то есть локализация и распознавание символов с помощью нейросетей. Для этого используются сверточные сети, рекуррентные сети и архитектуру кодировщика-декодера

Самая базовая модель - это сверточная рекуррентная нейросеть (Convolutional Recurrent Neural Network, CRNN), но такие сети вычислительно сложные, сложно тренировать

Более эффективная модель - EAST (Efficient Accurate Scene Text Detector), где есть две стадии - сверточная сеть и алгоритм Non-Maximum Suppression

Для распознавания текста существуют популярные библиотеки:

- Tesseract OCR - https://github.com/tesseract-ocr/tesseract

- PaddleOCR - https://github.com/PaddlePaddle/PaddleOCR

- EasyOCR - https://github.com/JaidedAI/EasyOCR

- Kraken - https://github.com/mittagessen/kraken